Hluboké učení

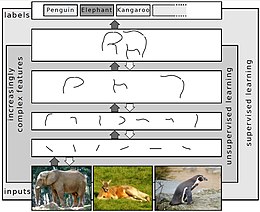

Hluboké učení[2] (anglicky deep learning) je disciplína spadající do kategorie strojového učení. Zabývá se vývojem a aplikací algoritmů pro učení umělých neuronových sítí s hierarchickou reprezentací vlastností (angl. features). Učení může probíhat tzv. s učitelem (angl. supervised), bez učitele (angl. unsupervised), nebo může jít o kombinaci obojího (angl. semi-supervised).[3]

Hluboké učení umožňuje extrakci komplexních vlastností (angl. features) z neupravených dat.[4]:s.199–200 Například při zpracování obrazu nižší vrstvy modelu identifikují hrany v obrazových datech sousedících pixelů, zatímco vyšší vrstvy pracují s obecnějšími koncepty bližšími lidskému chápání, jako jsou číslice, písmena nebo tváře.

Mělké učení může dosáhnout podobných výsledků s méně prostředky, takže existuje i ekologičtější přístup.[5]

Různé varianty hlubokého učení jsou využívány v oborech počítačového vidění, rozpoznávání řeči, zpracování přirozeného jazyka, strojového překladu, bioinformatiky, návrhu léčiv, analýzy lékařských snímků, výzkumu klimatu a hraní deskových her (kde tyto metody dosáhly srovnatelných nebo lepších výsledků než profesionální hráči).[6][7][8][9][10]

Definice

Pojem „hluboké“ se vztahuje k počtu vrstev neuronů, ve kterých probíhá transformace dat. Přesněji řečeno jde o počet transformací dat cestou ze vstupu (vstupní vrstva) na výstup (výstupní vrstva). Pro dopředné neuronové sítě je hloubka sítě dána jako počet mezilehlých skrytých vrstev. Neexistuje proto obecně platná hranice, která by oddělovala hluboké učení od ne-hlubokého učení. Hloubka sítě musí být minimálně 1, neboť tehdy je již síť schopna aproximovat libovolnou vektorovou funkci.[11] Přidávání dalších vrstev nezlepšuje aproximační schopnosti sítě, ale umožňuje extrahovat z dat komplexnější vlastnosti. Větší počet vrstev tak zefektivňuje proces učení. U rekurentních neuronových sítí může signál putovat každou vrstvou několikrát.[12]

Pro odhad parametrů sítě (trénování) se obvykle používá algoritmus zpětného šíření chyby. Trénování probíhá ve dvou fázích, tj. nejprve předučení sítě dopředným směrem např. pomocí autoenkodérů (učení bez učitele) a poté doučení sítě zpětným směrem (učení s učitelem). Eliminuje se tak tlumení zpětného šíření chyby.

Historie

Hlavní dopad hlubokého učení nastal po roce 2000. Podle Yanna LeCuna[13] již tehdy zpracovávaly dopředné konvoluční sítě 10% až 20% objemu všech šeků vypsaných ve Spojených státech. Využití hlubokého učení pro zpracování řeči začalo ve větším měřítku kolem roku 2010.

Dalšímu zájmu o hluboké učení napomohly pokroky v oblasti hardwaru. Společnost Nvidia napomohla v roce 2009 tzv. "velkému třesku" hlubokého učení, které probíhalo tréninkem neuronových sítích na GPU.[14] Andrew Ng toho roku odhadl, že díky GPU se může rychlost systémů hlubokého učení zvýšit až 100krát.[15] To zejména díky optimalizaci GPU pro práci s vektory a maticemi, jichž se ve strojovém učení užívá.[16][17][18]

Revoluce hlubokého učení

V roce 2012 tým vedený Georgem E. Dahlem využil víceúlohovou hlubokou neuronovou síť k předpovědi biologického cíle konkrétního léku.[19][20] V roce 2014 Hochreiterova skupina využila hluboké učení k detekci nežádoucích účinků chemikálií obsažených ve výživě, výrobcích pro domácnost a lécích na životní prostředí.[21][22][23]

Další významné pokroky v oblasti rozpoznávání obrazu proběhly v letech 2011 a 2012. Rychlé konvoluční neuronové sítě využívající pro svůj běh GPU přinesly důležitý pokrok v oblasti počítačového vidění.[16][18][24][25][12] V roce 2011 tento přístup poprvé vedl k překonání lidských schopností v rozpoznávání obrazových vzorů. Vedl rovněž k vítězství v soutěži rozpoznávání rukou psaného čínského písma.[26] V říjnu roku 2012 podobný systém s převahou zvítězil v soutěži projektu ImageNet.[8] V listopadu téhož roku další z těchto systémů zvítězil v ICPR soutěži v analýze lékařských snímků pro detekci rakoviny.[27] V letech 2013 a 2014 se chybovost systémů v úloze ImageNet dále snižovala, podobný trend zaznamenalo rovněž odvětví rozpoznávání řeči.

Dle některých výzkumníků bylo vítězství v ImageNet základem tzv. „revoluce hlubokého učení“ (angl. deep learning revolution), která transformovala celé odvětví umělé inteligence.[28]

V březnu 2019 byli Yoshua Bengio, Geoffrey Hinton a Yann LeCun vyznamenání Turingovou cenou za konceptuální a inženýrský průlom, který ustavil hluboké neuronové sítě jako stěžejní pilíř výpočetních věd.

Hardware

Během dekády 2010-2019 umožnily pokroky v učicích algoritmech a počítačovém hardwaru značné zefektivnění práce s hlubokými neuronovými sítěmi charakteristickými vysokým počtem skrytých vrstev a širokou výstupní vrstvou.[29] V roce 2019 už GPU s modifikacemi pro AI výpočty nahradily CPU v roli dominantního prostředku pro trénink komerčně využívané AI v cloudovém prostředí.[30] Společnost OpenAI odhadla odstup ve výkonu hardwaru využitého pro projekt hlubokého učení AlexNet z roku 2012 a pro projekt AlphaZero z roku 2017 a zjistila 300tisícinásobné navýšení výpočetního výkonu, tedy zdvojnásobení výkonu každého 3,4 měsíce[31][32] (pro srovnání Moorův zákon přisuzuje pokroku v hardwaru zdvojnásobování výpočetního výkonu každé 2 roky).

Pro akceleraci výpočtů souvisejících s hlubokým učením byly vyvinuty specializované výpočetní obvody - NPU (angl. neural processing unit) v mobilních zařízeních[33] a TPU (angl. tensor processing unit) pro výpočetní servery v rámci Google Cloud Platform.[34] Společnost Cerebras Systems vyvinula dedikovaný systém pro práci s modely hlubokého učení, nazvaný CS-2, založený na největším procesoru vůbec, druhé generaci WSE-2 (Wafer Scale Engine).[35][36]

V roce 2021 J. Feldmann a kolektiv navrhli pro účely konvolučního zpracování integrovaný fotonický hardwarový akcelerátor.[37] Autoři uvádějí dvě klíčové výhody fotonického řešení ve srovnání s klasickým elektronickým: (1) masivně paralelní zpracování dat díky multiplexu v rámci vlnových délek, (2) extrémně rychlou datovou modulaci.[37] Jejich systém dokáže provádět bilióny operací za sekundu, čímž vykazuje značný potenciál fotoniky pro budoucí využití v systémech spoléhajících na AI.[37]

Optimální hardwarová implementace provádění výpočtů umožňuje značně urychlit nalezení výsledku. Používají se různé způsoby:

- Tensor Processing Unit (TPU) [38] od Google jsou specializované integrované obvody ve formě čipů implementovaných v zařízení TPU (An application-specific integrated circuit (ASIC)), který optimalizuje výpočetní výkon strojového učení.

- Graphics Processing Unit (GPU) je systém procesorů implementovaných na grafické kartě, původně určený především pro běh počítačových her, kladoucích velké nároky na výpočetní výkon. Na rozdíl od CPU majících k dispozici maximálně 8 nebo 16 výpočetních vláken, GPU jich může využívat až např. 2 048. Pro algoritmizaci učení se pak může užít tzv. CUDA platforma, umožňující programovat v jazicích C++ resp. Fortran, která umožní díky velkému počtu dostupných výpočetních vláken vysoký stupeň paralelizace výpočtu, čímž zvýší výpočetní výkon strojového učení.

Využití

Rozpoznávání obrazu

Rozpoznávání obrazu založené na hlubokém učení již překonalo schopnosti člověka. Poprvé se tak stalo v roce 2011 při rozpoznávání dopravního značení, poté v roce 2014 v rozpoznávání lidských tváří.[39][40] Vozidla využívající hluboké učení dnes analyzují 360° kamerové záběry v reálném čase.[41]

Pro rozpoznávání obrazu se dnes užívají Konvoluční neuronové sítě (CNN), které jsou specializovaným typem umělých neuronových sítí, které alespoň v jedné ze svých vrstev používají matematickou operaci zvanou konvoluce namísto obecného násobení matic[42]. Jsou speciálně navrženy pro zpracování pixelových dat a používají se při rozpoznávání a zpracování obrazu.

V porovnání s jinými algoritmy klasifikace obrazu používají CNN relativně málo předzpracování. To znamená, že síť se učí optimalizovat filtry (nebo jádra) prostřednictvím automatického učení, zatímco v tradičních algoritmech jsou tyto filtry vytvářeny ručně. Tato nezávislost na předchozích znalostech a lidských zásazích do extrakce příznaků je velkou výhodou.

Pro klasifikaci ručně psaných číslic se běžně využívá datový soubor MNIST. Jde o vzorník ručně psaných číslic obsahující 60 tisíc trénovacích položek a 10 tisíc testovacích položek. Relativně malý datový objem umožňuje testovat různé konfigurace systému pro rozpoznávání.[43]

Automatické rozpoznávání řeči

Automatické rozpoznávání řeči je nejočividnější aplikací hlubokého učení s širokým využitím. Rekurentní neuronové sítě jsou schopné zpracovávat i „velmi hluboké úlohy“,[12] které obsahují intervaly několika sekund trvající mluvené řeči oddělené několika tisíci diskrétních časových kroků, kde jeden krok odpovídá zhruba 10 ms.

Počátečního úspěchu v rozpoznávání řeči bylo dosaženo na úlohách malého rozsahu založených na TIMIT (vzorník mluvené americké angličtiny od různých mluvčích doplněný transkripcí). Tato data obsahují po deseti větách od 630 mluvčích hovořících v osmi hlavních dialektech americké angličtiny.[44]

Všechny dnes komerčně široce využívané systémy pro rozpoznávání řeči (Microsoft Cortana, Amazon Alexa, Google Now, Apple Siri a další) jsou založeny na hlubokém učení.[4][45][46]

Zpracování přirozeného jazyka

Klíčovou technikou v tomto oboru je vnoření slov (angl. word embedding). Tento přístup reprezentuje každé jednotlivé slovo jako pozici ve vícerozměrném prostoru relativně vůči dalším slovům obsaženým v datovém souboru. Využití vnoření slov na vstupní vrstvě umožňuje rekurentním neuronovým sítím provádět rozbor vět a frází efektivní vektorovou gramatikou. Rekurzivní autoenkodéry umožňují posoudit příbuznost vět a detekovat parafráze.[47]

Nedávné pokroky zobecnily vnoření slov na vnoření celých vět (angl. sentence embedding).

Překladač Google a Google Neural Machine Translation využívají techniky hlubokého učení. Překladač Google díky tomu překládá významy vět namísto překladu jednotlivých frází. Podporuje přes sto jazyků[48] a využívá angličtinu jako prostředníka pro překlad mezi libovolnými dvěma jazyky.[49]

Analýza lékařských snímků

Hluboké učení prokázalo konkurenceschopnost v medicínských aplikacích, jako je klasifikace rakovinných buněk, detekce lézí, vylepšení obrazu a dalších.[50][51] Moderní nástroje využívající hluboké učení prokazují vysokou přesnost v detekci různých chorob a jejich využití dovoluje odborníkům zvyšovat efektivitu diagnóz.[52][53]

Rekonstrukce obrazu

Jde o rekonstrukci obrazu na základě podkladových dat, která se k obrazu vážou, jako je například spektroskopické zobrazování nebo ultrazvukové zobrazování. Několik prací na toto téma demonstrovalo lepší výkon systémů využívajících hluboké učení ve srovnání s uvedenými metodami.[54][55]

Detekce finančních podvodů

Hluboké učení se úspěšně uplatňuje v detekci finančních podvodů,[56] detekci daňových úniků a praní špinavých peněz.[57]

Zpracování uměleckých děl

Úzce spjaté s obecným rozpoznáváním obrazu je využití hlubokého učení pro různé typy zadání týkající se uměleckých děl. Hluboké neuronové sítě se prokázaly schopnými např.:

- zachytit výtvarný styl daného díla a poté ho aplikovat na libovolnou fotografii či video[58][59]

- generovat obrazy založené na náhodných vstupech (např. software DeepDream společnosti Google)[58][59]

Kritika

Hluboké učení na sebe strhlo vlnu kritiky, a to nejen z okruhu počítačových věd.

Teoretické pozadí

Hlavní kritika hlubokého učení se týká nedostatku teoretického pozadí jeho některých metod.[60] V nejběžnějších případech je učení implementováno pomocí dobře prozkoumané gradientní metody. Jiné metody však takto dobře vysvětleny nejsou. Často je na ně nahlíženo jako na černou skříňku, kde je většina závěrů o fungování modelu utvářena na základě empirických výsledků, ne teorie.[61]

Chybná funkce

Některé systémy hlubokého učení vykazují problematické chování,[62] jako je například zařazování objektivně nerozpoznatelných obrázků do známých kategorií[63] nebo naopak nesprávné zařazování obrázků na základě pouze drobných změn.[64] Goertzel se domnívá, že toto chování může být způsobeno limitací vnitřní reprezentace.[62]

Kybernetická hrozba

S tím, jak se hluboké učení postupně dostává do běžného užívání, výzkum a zkušenosti ukazují, že jsou umělé neuronové sítě zranitelné podvratným jednáním.[65] Útočník může například pomocí analýzy vnitřního fungování systému upravit hledaný obrázek tak, že síť nalezne shodu, přestože z lidského hlediska jde o zcela nesouvisející obrázky.[66]

V roce 2016 výzkumníci využili jednu neuronovou síť k takovéto záměrné úpravě obrázků. Identifikovali vzory chování druhé sítě a pak byli schopni vygenerovat obrázky, které dokázaly tuto síť zmást. Upravené obrázky vypadaly pro lidské oko nerozlišitelně. Jiná skupina ukázala, že i vytištěné upravené obrázky jsou následně chybně zařazovány.[67] Jedna z forem obrany proti takovému postupu by mohla souviset s využitím zpětného vyhledávání obrázků (angl. reverse image search, kde je podezřelý obrázek nejprve uploadován do služby jako např. TinEye, kde lze vyhledat ostatní jeho výskyty. Vylepšením může být vyhledávání pouze částí obrázku.[68]

Umělé neuronové sítě mohou být nicméně trénovány k rozpoznávání případů takového napadení. To může ve výsledku vést k závodům ve zbrojení podobným malwarové scéně.

Existuje rovněž technika „otravy dat“ (angl. data poisoning), kdy jsou podvržená data propašována do tréninkového datového souboru, což učícímu se systému znemožňuje dosahovat přesných výsledků.[67]

Reference

V tomto článku byl použit překlad textu z článku Deep learning na anglické Wikipedii.

- ↑ SCHULZ, Hannes; BEHNKE, Sven. Deep Learning. KI - Künstliche Intelligenz. 1 November 2012, s. 357–363. Dostupné online. ISSN 1610-1987. DOI 10.1007/s13218-012-0198-z. S2CID 220523562. (anglicky)

- ↑ GOODFELLOW, Ian; BENGIO, Yoshua; COURVILLE, Aaron. Deep Learning. [s.l.]: MIT Press, 2016. 767 s. Dostupné online. (anglicky)

- ↑ LECUN, Yann; BENGIO, Yoshua; HINTON, Geoffrey. Deep Learning. Nature. 2015, s. 436–444. DOI 10.1038/nature14539. PMID 26017442. S2CID 3074096. Bibcode 2015Natur.521..436L.

- ↑ a b DENG, L.; YU, D. Deep Learning: Methods and Applications. Foundations and Trends in Signal Processing. 2014, s. 1–199. Dostupné v archivu pořízeném z originálu dne 2016-03-14. DOI 10.1561/2000000039.

- ↑ New technique based on 18th-century mathematics shows simpler AI models don't need deep learning. techxplore.com [online]. [cit. 2023-10-05]. Dostupné online.

- ↑ ROLNICK, David, et al. Tackling Climate Change with Machine Learning. ACM Computing Surveys [online]. 2022-02-07 [cit. 2022-02-01]. Dostupné online. ISSN 03600300. DOI 10.1145/3485128.

- ↑ CIRESAN, D.; MEIER, U.; SCHMIDHUBER, J. 2012 IEEE Conference on Computer Vision and Pattern Recognition. [s.l.]: [s.n.], 2012. ISBN 978-1-4673-1228-8. DOI 10.1109/cvpr.2012.6248110. S2CID 2161592. arXiv 1202.2745. Kapitola Multi-column deep neural networks for image classification, s. 3642–3649.

- ↑ a b KRIZHEVSKY, Alex; SUTSKEVER, Ilya; HINTON, Geoffrey. ImageNet Classification with Deep Convolutional Neural Networks. NIPS 2012: Neural Information Processing Systems, Lake Tahoe, Nevada. 2012. Dostupné v archivu pořízeném z originálu dne 2017-01-10.

- ↑ Google's AlphaGo AI wins three-match series against the world's best Go player [online]. 25 May 2017 [cit. 2018-06-17]. Dostupné v archivu pořízeném z originálu dne 17 June 2018.

- ↑ SHIGEKI, Sugiyama. Human Behavior and Another Kind in Consciousness: Emerging Research and Opportunities: Emerging Research and Opportunities. [s.l.]: IGI Global, 12 April 2019. Dostupné online. ISBN 978-1-5225-8218-2. (anglicky)

- ↑ HORNIK, Kurt. Multilayer feedforward networks are universal approximators. www.sciencedirect.com. Elsevier, Neural Networks Volume 2, Issue 5, 1989, Pages 359-366. Dostupné online. (anglicky)

- ↑ a b c SCHMIDHUBER, J. Deep Learning in Neural Networks: An Overview. Neural Networks. 2015, s. 85–117. DOI 10.1016/j.neunet.2014.09.003. PMID 25462637. S2CID 11715509. arXiv 1404.7828.

- ↑ Yann LeCun (2016). Slides on Deep Learning Online Archivováno 23. 4. 2016 na Wayback Machine.

- ↑ Nvidia CEO bets big on deep learning and VR [online]. Venture Beat, 5 April 2016 [cit. 2017-04-21]. Dostupné v archivu pořízeném z originálu dne 25 November 2020.

- ↑ From not working to neural networking. The Economist. Dostupné v archivu pořízeném z originálu dne 2016-12-31.

- ↑ a b OH, K.-S.; JUNG, K. GPU implementation of neural networks. Pattern Recognition. 2004, s. 1311–1314. DOI 10.1016/j.patcog.2004.01.013. Bibcode 2004PatRe..37.1311O.

- ↑ "A Survey of Techniques for Optimizing Deep Learning on GPUs Archivováno 9. 5. 2021 na Wayback Machine.", S. Mittal and S. Vaishay, Journal of Systems Architecture, 2019

- ↑ a b CHELLAPILLA, Kumar; PURI, Sidd; SIMARD, Patrice. High performance convolutional neural networks for document processing. [s.l.]: [s.n.], 2006. Dostupné v archivu pořízeném z originálu dne 2020-05-18.

- ↑ Merck Molecular Activity Challenge [online]. [cit. 2020-07-16]. Dostupné v archivu pořízeném z originálu dne 2020-07-16.

- ↑ Multi-task Neural Networks for QSAR Predictions | Data Science Association [online]. [cit. 2017-06-14]. Dostupné v archivu pořízeném z originálu dne 30 April 2017.

- ↑ "Toxicology in the 21st century Data Challenge"

- ↑ NCATS Announces Tox21 Data Challenge Winners [online]. [cit. 2015-03-05]. Dostupné v archivu pořízeném z originálu dne 2015-09-08.

- ↑ NCATS Announces Tox21 Data Challenge Winners [online]. [cit. 2015-03-05]. Dostupné v archivu pořízeném z originálu dne 28 February 2015.

- ↑ LeCun et al., "Backpropagation Applied to Handwritten Zip Code Recognition," Neural Computation, 1, pp. 541–551, 1989.

- ↑ CIRESAN, D. C.; MEIER, U.; MASCI, J.; GAMBARDELLA, L. M.; SCHMIDHUBER, J. Flexible, High Performance Convolutional Neural Networks for Image Classification. International Joint Conference on Artificial Intelligence. 2011. Dostupné v archivu pořízeném z originálu dne 2014-09-29. DOI 10.5591/978-1-57735-516-8/ijcai11-210.

- ↑ CIRESAN, Dan; GIUSTI, Alessandro; GAMBARDELLA, Luca M.; SCHMIDHUBER, Juergen. Advances in Neural Information Processing Systems 25. Redakce Pereira F.. [s.l.]: Curran Associates, Inc., 2012. Dostupné v archivu pořízeném z originálu dne 2017-08-09. S. 2843–2851.

- ↑ CIRESAN, D.; GIUSTI, A.; GAMBARDELLA, L.M.; SCHMIDHUBER, J. Mitosis Detection in Breast Cancer Histology Images using Deep Neural Networks. Proceedings MICCAI. 2013, s. 411–418. ISBN 978-3-642-38708-1. DOI 10.1007/978-3-642-40763-5_51. PMID 24579167.

- ↑ Why Deep Learning Is Suddenly Changing Your Life. Fortune. 2016. Dostupné v archivu pořízeném z originálu dne 14 April 2018.

- ↑ RESEARCH, AI. Deep Neural Networks for Acoustic Modeling in Speech Recognition [online]. 23 October 2015 [cit. 2015-10-23]. Dostupné v archivu pořízeném z originálu dne 1 February 2016.

- ↑ GPUs Continue to Dominate the AI Accelerator Market for Now. InformationWeek. December 2019. Dostupné v archivu pořízeném z originálu dne 10 June 2020. (anglicky)

- ↑ RAY, Tiernan. AI is changing the entire nature of computation. ZDNet. 2019. Dostupné v archivu pořízeném z originálu dne 25 May 2020. (anglicky)

- ↑ AI and Compute [online]. 16 May 2018 [cit. 2020-06-11]. Dostupné v archivu pořízeném z originálu dne 17 June 2020. (anglicky)

- ↑ HUAWEI Reveals the Future of Mobile AI at IFA 2017 | HUAWEI Latest News | HUAWEI Global [online]. Dostupné online.

- ↑ P, JouppiNorman; YOUNGCLIFF; PATILNISHANT; PATTERSONDAVID; AGRAWALGAURAV; BAJWARAMINDER; BATESSARAH. In-Datacenter Performance Analysis of a Tensor Processing Unit. ACM SIGARCH Computer Architecture News. 2017-06-24, s. 1–12. DOI 10.1145/3140659.3080246. (EN)

- ↑ WOODIE, Alex. Cerebras Hits the Accelerator for Deep Learning Workloads [online]. 2021-11-01 [cit. 2022-08-03]. Dostupné online.

- ↑ Cerebras launches new AI supercomputing processor with 2.6 trillion transistors [online]. 2021-04-20 [cit. 2022-08-03]. Dostupné online. (anglicky)

- ↑ a b c FELDMANN, J.; YOUNGBLOOD, N.; KARPOV, M.; GEHRING, H. Parallel convolutional processing using an integrated photonic tensor. Nature. 2021, s. 52–58. DOI 10.1038/s41586-020-03070-1. PMID 33408373. S2CID 211010976. arXiv 2002.00281.

- ↑ Google developers: Machine Learning Glossary

- ↑ CIREŞAN, Dan; MEIER, Ueli; MASCI, Jonathan; SCHMIDHUBER, Jürgen. Multi-column deep neural network for traffic sign classification. Neural Networks. August 2012, s. 333–338. DOI 10.1016/j.neunet.2012.02.023. PMID 22386783.

- ↑ arXiv: 1404.3840

- ↑ Nvidia Demos a Car Computer Trained with "Deep Learning" (6 January 2015), David Talbot, MIT Technology Review

- ↑ IAN GOODFELLOW AND YOSHUA BENGIO AND AARON COURVILLE. Deep Learning. [s.l.]: MIT Press, 2016. Dostupné online. S. 326.

- ↑ MNIST handwritten digit database, Yann LeCun, Corinna Cortes and Chris Burges [online]. [cit. 2014-01-28]. Dostupné v archivu pořízeném z originálu dne 2014-01-13.

- ↑ TIMIT Acoustic-Phonetic Continuous Speech Corpus Linguistic Data Consortium, Philadelphia.

- ↑ www.wired.com. Dostupné online.

- ↑ arXiv: 1412.5567

- ↑ SOCHER, Richard; MANNING, Christopher. Deep Learning for NLP [online]. [cit. 2014-10-26]. Dostupné v archivu pořízeném z originálu dne 6 July 2014.

- ↑ SCHUSTER, Mike; JOHNSON, Melvin; THORAT, Nikhil. Zero-Shot Translation with Google's Multilingual Neural Machine Translation System [online]. 22 November 2016 [cit. 2017-03-23]. Dostupné v archivu pořízeném z originálu dne 10 July 2017.

- ↑ BOITET, Christian; BLANCHON, Hervé; SELIGMAN, Mark; BELLYNCK, Valérie. MT on and for the Web [online]. 2010 [cit. 2016-12-01]. Dostupné v archivu pořízeném z originálu dne 29 March 2017.

- ↑ LITJENS, Geert; KOOI, Thijs; BEJNORDI, Babak Ehteshami; SETIO, Arnaud Arindra Adiyoso; CIOMPI, Francesco; GHAFOORIAN, Mohsen; VAN DER LAAK, Jeroen A.W.M. A survey on deep learning in medical image analysis. Medical Image Analysis. December 2017, s. 60–88. DOI 10.1016/j.media.2017.07.005. PMID 28778026. S2CID 2088679. Bibcode 2017arXiv170205747L. arXiv 1702.05747.

- ↑ FORSLID, Gustav; WIESLANDER, Hakan; BENGTSSON, Ewert; WAHLBY, Carolina; HIRSCH, Jan-Michael; STARK, Christina Runow; SADANANDAN, Sajith Kecheril. 2017 IEEE International Conference on Computer Vision Workshops (ICCVW). [s.l.]: [s.n.], 2017. ISBN 9781538610343. DOI 10.1109/ICCVW.2017.18. S2CID 4728736. Kapitola Deep Convolutional Neural Networks for Detecting Cellular Changes Due to Malignancy, s. 82–89.

- ↑ DONG, Xin; ZHOU, Yizhao; WANG, Lantian; PENG, Jingfeng; LOU, Yanbo; FAN, Yiqun. Liver Cancer Detection Using Hybridized Fully Convolutional Neural Network Based on Deep Learning Framework. IEEE Access. 2020, s. 129889–129898. Dostupné online. ISSN 2169-3536. DOI 10.1109/ACCESS.2020.3006362. S2CID 220733699.

- ↑ LYAKHOV, Pavel Alekseevich; LYAKHOVA, Ulyana Alekseevna; NAGORNOV, Nikolay Nikolaevich. System for the Recognizing of Pigmented Skin Lesions with Fusion and Analysis of Heterogeneous Data Based on a Multimodal Neural Network. Cancers. 2022-04-03, s. 1819. ISSN 2072-6694. DOI 10.3390/cancers14071819. PMID 35406591. (anglicky)

- ↑ OKTEM, Figen S.; KAR, Oğuzhan Fatih; BEZEK, Can Deniz; KAMALABADI, Farzad. High-Resolution Multi-Spectral Imaging With Diffractive Lenses and Learned Reconstruction. IEEE Transactions on Computational Imaging. 2021, s. 489–504. Dostupné online. ISSN 2333-9403. DOI 10.1109/TCI.2021.3075349. S2CID 235340737. arXiv 2008.11625.

- ↑ BERNHARDT, Melanie; VISHNEVSKIY, Valery; RAU, Richard; GOKSEL, Orcun. Training Variational Networks With Multidomain Simulations: Speed-of-Sound Image Reconstruction. IEEE Transactions on Ultrasonics, Ferroelectrics, and Frequency Control. December 2020, s. 2584–2594. Dostupné online. ISSN 1525-8955. DOI 10.1109/TUFFC.2020.3010186. PMID 32746211. S2CID 220055785. arXiv 2006.14395.

- ↑ KLEANTHOUS, Christos; CHATZIS, Sotirios. Gated Mixture Variational Autoencoders for Value Added Tax audit case selection. Knowledge-Based Systems. 2020, s. 105048. DOI 10.1016/j.knosys.2019.105048. S2CID 204092079.

- ↑ CZECH, Tomasz. Deep learning: the next frontier for money laundering detection. Global Banking and Finance Review. 28 June 2018. Dostupné v archivu pořízeném z originálu dne 2018-11-16.

- ↑ a b c G. W. Smith; FREDERIC FOL LEYMARIE. The Machine as Artist: An Introduction. Arts. 10 April 2017, s. 5. DOI 10.3390/arts6020005.

- ↑ a b c Blaise Agüera y Arcas. Art in the Age of Machine Intelligence. Arts. 29 September 2017, s. 18. DOI 10.3390/arts6040018.

- ↑ MARCUS, Gary. In defense of skepticism about deep learning [online]. 14 January 2018 [cit. 2018-10-11]. Dostupné v archivu pořízeném z originálu dne 12 October 2018.

- ↑ KNIGHT, Will. DARPA is funding projects that will try to open up AI's black boxes [online]. 14 March 2017 [cit. 2017-11-02]. Dostupné v archivu pořízeném z originálu dne 4 November 2019.

- ↑ a b GOERTZEL, Ben. Are there Deep Reasons Underlying the Pathologies of Today's Deep Learning Algorithms? [online]. 2015 [cit. 2015-05-10]. Dostupné v archivu pořízeném z originálu dne 2015-05-13.

- ↑ arXiv: 1412.1897

- ↑ arXiv: 1312.6199

- ↑ Hackers Have Already Started to Weaponize Artificial Intelligence [online]. 11 September 2017 [cit. 2019-10-11]. Dostupné v archivu pořízeném z originálu dne 11 October 2019.

- ↑ How hackers can force AI to make dumb mistakes [online]. 18 June 2018 [cit. 2019-10-11]. Dostupné v archivu pořízeném z originálu dne 11 October 2019. (anglicky)

- ↑ a b AI Is Easy to Fool—Why That Needs to Change. Singularity Hub. 10 October 2017. Dostupné v archivu pořízeném z originálu dne 11 October 2017.

- ↑ GIBNEY, Elizabeth. The scientist who spots fake videos. Nature. 2017. Dostupné v archivu pořízeném z originálu dne 2017-10-10. DOI 10.1038/nature.2017.22784.

Literatura

- KŘIVAN, Miloš. Umělé neuronové sítě. [s.l.]: Nakladatelství Oeconomica, Vysoká škola ekonomická v Praze 77 s. Dostupné online. ISBN 978-80-245-2420-7.

Externí odkazy

Obrázky, zvuky či videa k tématu hluboké učení na Wikimedia Commons

Obrázky, zvuky či videa k tématu hluboké učení na Wikimedia Commons - Blog o hlubokém učení (Jan Matoušek)

Média použitá na této stránce

Autor: Sven Behnke, Licence: CC BY-SA 4.0

Schematic overview of layer-wise learning of

feature hierarchies. Increasingly complex features are determined from input using unsupervised learning. The

features can be used for supervised task learning.